Мы используем файлы cookie.

Для улучшения вашего пользовательского опыта мы используем файлы cookie. Узнать больше

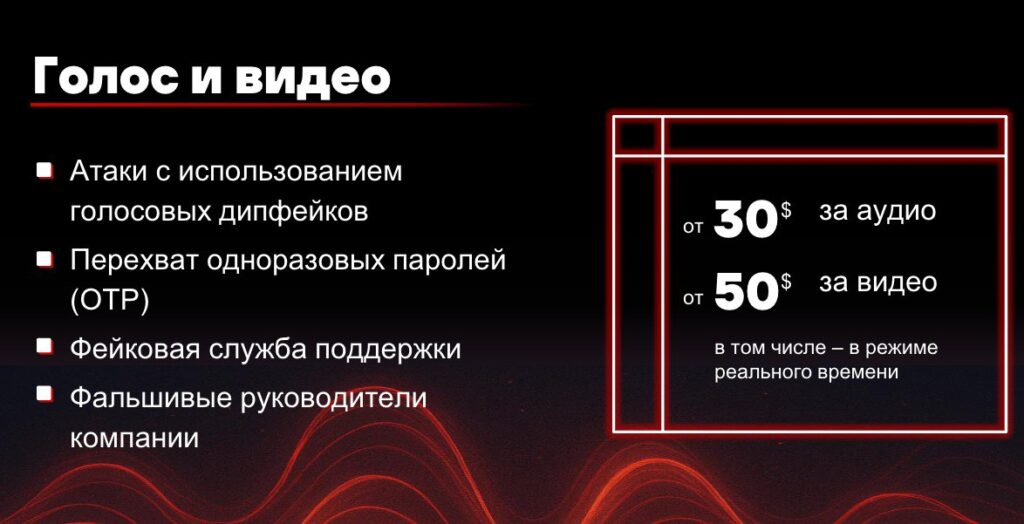

Эксперты «Лаборатории Касперского» выявили в даркнете рост предложений и спроса по созданию видео- и аудиодипфейков в режиме реального времени. Стоимость таких услуг варьируется в зависимости от сложности и длительности подделки — всего от 50 долларов за видео и от 30 долларов за голосовой контент.

Анализ русскоязычных и англоязычных теневых площадок, проведенный с помощью инструмента Kaspersky Digital Footprint Intelligence, показал, что злоумышленники активно предлагают подмену лица в видеоконференциях и мессенджерах, фальсификацию верификаций и замену изображения с камер устройств. Информация была озвучена на конференции Kaspersky CyberSecurity Weekend 2025 в Минске.

Злоумышленникам сегодня доступны программы для синхронизации губ с любым текстом, включая иностранные языки, а также инструменты для клонирования голоса с изменением тембра и эмоциональной окраски.

Эксперты считают вероятным, что многие объявления о создании качественных дипфейков являются мошенническими, будучи просто приманками для выманивания денег, так называемым скамом. Однако тенденция роста не только предложений подделок личностей, но и спроса на услуги создания дипфейков, настораживает.

По словам Игоря Кузнецова, директора Kaspersky GReAT, злоумышленники всё активнее применяют искусственный интеллект, включая сложные локальные модели и вредоносные языковые модели, что расширяет их возможности для кибератак. В ответ специалисты по кибербезопасности должны использовать современные ИИ-решения для эффективной защиты и повышения продуктивности.

«На теневых площадках мы видим не только объявления с предложениями „дипфейк-как-услуга“, но и спрос на такие услуги. Злоумышленники активно интересуются и уже используют в своей деятельности ИИ-сервисы», — рассказывает глава Kaspersky GReAT.

«Мы недавно проводили исследование, которое выявило, что более половины пользователей уже знают, что такое диппфейки, но, тем не менее, они работают. Ровно потому, что это максимально убедительная технология социальной инженерии. Достаточно от нескольких секунд до минут аудио или видео записи конкретного человека, например, переписка с аудиосообщением, или, если персона публичная, то интервью, для того, чтобы затем генерировать поддельное аудио или видео с нужными мошенникам словами. При этом цена генерации дипфейков сейчас только снижается», — подчеркивает Игорь Кузнецов.

Дипфейки используются для создания реалистичных поддельных видео и аудио, которые могут имитировать внешний вид и голос человека. В легитимных целях они иногда применяются в киноиндустрии, рекламе и развлечениях для визуальных эффектов и дубляжа. Однако в даркнете и криминальной среде дипфейки всё чаще используют для мошенничества, шантажа, манипуляций общественным мнением и обхода систем безопасности, например, верификации личности.

Современные технологии искусственного интеллекта позволяют заменять лицо и голос в режиме реального времени, что усложняет обнаружение подделок. Мошенники применяют дипфейки для имитации голосов руководителей компаний с целью вынудить сотрудников выполнить финансовые операции или раскрыть конфиденциальную информацию. Также дипфейки используются для создания фальшивых доказательств и дискредитации людей.

— Алексей Петренко

Техническая поддержка сайта от агентства "Простые решения"

Для улучшения вашего пользовательского опыта мы используем файлы cookie. Узнать больше